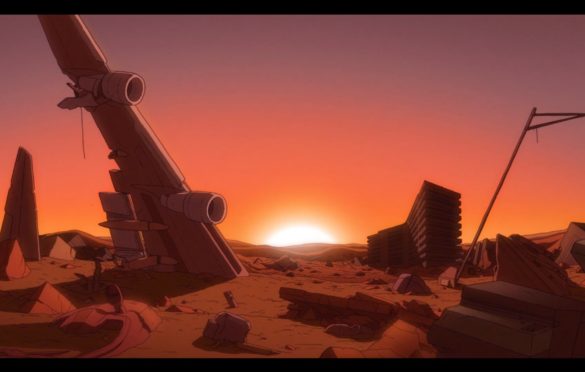

Im Kurzfilm “The Desert” wandern Roboter ziellos in einer menschenleeren Welt umher

Dieser Film von Michael Dockery hier ist sehr, sehr gut und stellt eine echt interessante Frage: Was, wenn wir sowas wie KI entwickeln und dann aussterben oder die KI sich selbst überlassen und sie ganz allein ist? Haben wir als Menschheit dann sowas wie eine Verantwortung für unsere Geschöpfe? Diese Frage haben ja schon viele Geschichten gestellt, von Asimov bis Blade Runner, aber eine schlussendliche Antwort haben sei auch nicht gegeben. Sicherlich, weil die Frage auch gar nicht so einfach zu beantworten ist. Sicherlich haben Eltern immer eine Verantwortung für ihre Kinder und diese Verbindung besteht ja auch über das Erwachsenwerden selbiger hinaus, allerdings sind ja auch die Eltern irgendwann nicht mehr und dann zeigt sich, ob die Kids es auch alleine schaffen. Andererseits ist man ja immer irgendwie für das verantwortlich, was man schafft. Sei es nun eine künstliche Intelligenz (oder sowas ähnliches) oder einfach der Müll, den wir auf dieser Welt hinterlassen. Schwierig. Zum Glück bin ich zu dumm, um versehentlich KI zu erschaffen. (via)

1 Comment

TURBOMARCOW (@Fadenaffe) · 23. Juli 2021 at 14:15

Im Kurzfilm „The Desert“ wandern Roboter ziellos in einer menschenleeren Welt umher https://t.co/yuu48epy8U